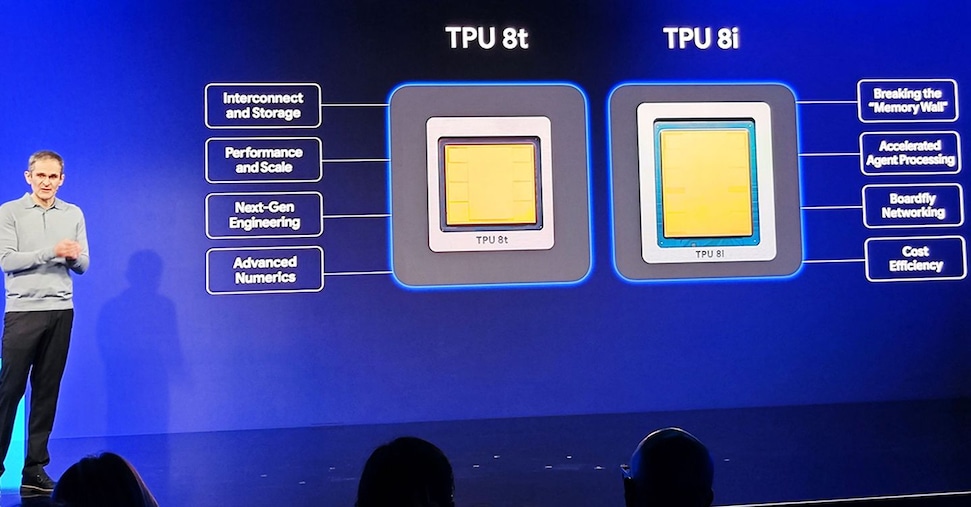

LAS VEGAS – Oggi parte il Google Cloud Next 2026, l’evento annuale di Las Vegas in cui la parte di Google dedicata a Cloud e AI mostra le novità previste per quest’anno a stampa, partner, fornitori e clienti. Sono attesi keynote sulla strategia aziendale, presentazioni di prodotto e varie iniziative per far fare l’ennesimo balzo in avanti al mercato su Agenti AI (sempre più in voga) ed elaborazione dati in salsa Intelligenza Artificiale. Ma ieri si è tenuta nella struttura della Formula 1 della città del vizio una presentazione dedicata ai suoi nuovi due processori due nuovi processori custom appartenenti all’ottava generazione di TPU. Google Cloud progetta da sola i suoi processori per datacenter dal 2013 e da qualche tempo il ritmo dei prodotti si è intensificato e, addirittura, il CTO dell’azienda, Amin Vahdat, ha anticipato che già l’anno prossimo potremmo vederne tre se l’evoluzione del settore AI procede a questo ritmo forsennato. Per il momento, però, abbiamo TPU 8T e TPU 8i, nati dalla consapevolezza che un’unica soluzione non può più soddisfare in modo efficiente le diverse esigenze del ciclo di vita dell’IA.

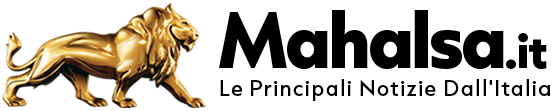

In particolare, il TPU 8T è progettato come il “motore di potenza” dedicato all’addestramento (training) dei modelli su grande scala. TPU 8i, invece, è stato progettato per l’inferenza (inference) e il ragionamento, ottimizzandolo per garantire la minima latenza possibile e per le risposte in tempo reale, fondamentali nell’era degli agenti IA.

Secondo Vahdat, questa separazione è stata necessaria perché, sebbene l’addestramento sia il carico di lavoro dominante oggi, il valore reale per servizi come Search, YouTube o Gemini Enterprise viene creato durante la fase di “serving” (inferenza).

Caratteristiche principali e confronto generazionale

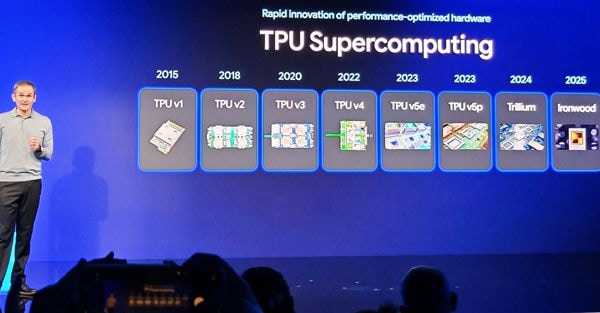

I miglioramenti rispetto alla generazione precedente (Ironwood) sono definiti “sbalorditivi”, con le prestazioni che vengono moltiplicate anche quasi 10 volte in alcuni carichi. TPU v8T (Training) è composto da 9.600 chip interconnessi e offre quasi tre volte la potenza di calcolo in virgola mobile rispetto alla generazione precedente. TPU 8i (Inference), invece, strabilia tutti con un’architettura che quadruplica la dimensione del pod (ora con 1.152 chip coordinati) e offre 10 volte gli exaflops in virgola mobile rispetto al chip procedente (che bisogna ricordare che non era ottimizzato per questo compito, però).

Il futuro dell’infrastruttura: il grande ritorno delle CPU

Nonostante l’importanza per Google di questi annunci, che permetteranno di rendere ancora più efficaci i suoi servizi contenendone i costi, Vahdat ha condiviso una previsione controintuitiva: la decisione di Google di produrre da sé dei processori ottimizzati per i carichi AI era nata dalla necessità di potenza bruta in applicazioni dove l’evoluzione delle CPU non riusciva a reggere il passo delle necessità delle aziende che avevano bisogno di processare enormi quantità di dati (come Google e il suo indice del Web). Adesso, Vahdat prevedere che nei prossimi anni le CPU torneranno a giocare un ruolo fondamentale. Nonostante l’era della specializzazione estrema stia continuando, la complessità degli agenti IA richiede una grande quantità di calcolo generico per compiti come l’orchestrazione, la creazione di sandbox sicure e l’esecuzione di codice, tutti campi in cui le CPU funzionano molto bene.