Ma davvero il nostro gatto ci salta addosso se ci vede tagliare una torta a forma di gatto? E davvero è possibile camminare sull’acqua legandosi ai piedi tantissime bottigliette vuote? Se vedendo un video su internet ci è venuto il dubbio, sappiamo di cosa stiamo parlando: adesso è davvero difficile potersi fidarsi di qualunque immagine o video. Se invece il dubbio non c’è mai venuto, è peggio: significa che siamo facili vittime di bufale e alla disinformazione. Nessun inganno è innocuo come ci può sembrare. Nella migliore delle ipotesi abbiamo perso del tempo vedendo acrobazie, incidenti, stranezze credendoli veri. Nella peggiore, rischiamo conseguenze nel mondo reale. Di finire in mare con tutti i vestiti, ad esempio. O di subire la propaganda, pensando ad esempio che davvero l’avvocata per i diritti civili Nekima Levy Armstrong abbia pianto durante l’arresto nel Minnesota. Un altro caso di immagine alterata con l’AI. Ancora più grave che l’autore della finzione sia il Governo degli Stati Uniti.

Il problema è che questa invasione dei finti video AI era ampiamente prevista; previsti anche i danni che ne possono venire; e da anni, persino, sarebbero disponibili alcuni rimedi, sia tecnici sia normativi. Peccato che hanno fallito tutti questi, almeno per ora. Adesso, a tre anni circa dall’avvento dell’AI generativa, è possibile fare un bilancio, con anche un possibile indiziato come principale responsabile del flop: le grandi piattaforme social, che non hanno nessun interesse a diffondere etichette o altri sistemi per filtrare “l’AI slop”, i contenuti generati con l’AI e di qualità dubbia. L’AI sta aumentando di molto i contenuti video disponibili sui social e quindi l’engagement del pubblico.

Senza una collaborazione delle piattaforme è difficile che qualcosa cambi.

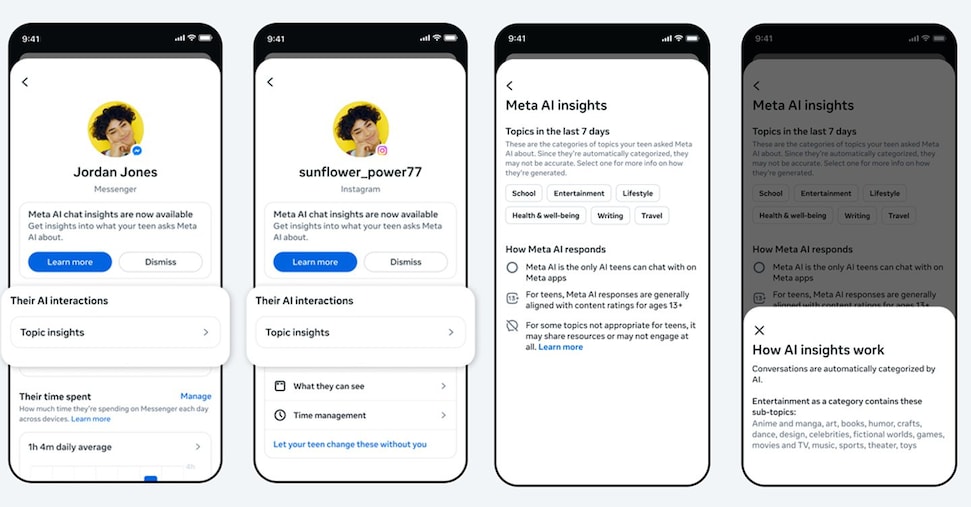

Per anni la risposta tecnica è sembrata semplice: aggiungere ai contenuti digitali una sorta di etichetta nutrizionale. È l’idea alla base di c2pa, lo standard di “Content Credentials” promosso da aziende come Adobe, Microsoft, OpenAI, Meta, Google e molte altre, riunite nella Coalition for Content Provenance and Authenticity. Secondo il sito ufficiale di Content Credentials oggi partecipano più di 500 aziende.

C2pa estende i vecchi metadati Exif delle fotografie: dentro al file si registra, in modo firmato crittograficamente, la storia del contenuto. La fotocamera o la videocamera scrive chi ha scattato, con quale dispositivo, in che momento. Il software di editing aggiunge le modifiche, compreso l’uso di strumenti generativi. I file viaggiano accompagnati da questo “manifesto” che, in teoria, le piattaforme dovrebbero leggere per mostrare al pubblico un pannello con autore, app utilizzate, eventuale uso di AI.

Negli ultimi anni alcune fotocamere professionali – per esempio modelli di Sony, Nikon e Leica – hanno iniziato a integrare Content Credentials all’origine, e software come Photoshop o Lightroom possono già scrivere manifest C2PA nei file.