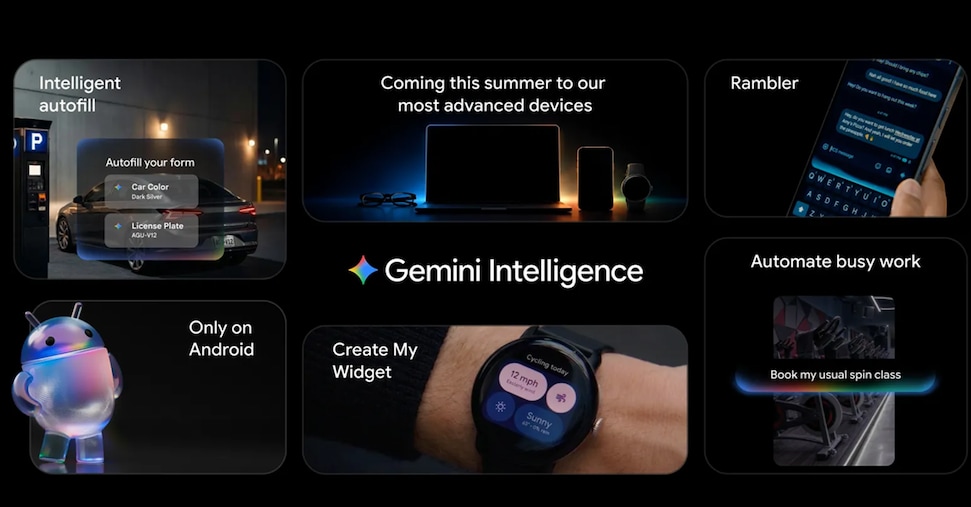

Non più soltanto un sistema operativo, ma una piattaforma cognitiva capace di comprendere il contesto, anticipare le intenzioni dell’utente e agire in autonomia dentro applicazioni, browser e servizi. Da Android Show 2026, l’evento con cui Google ha anticipato le principali novità che animeranno l’imminente I/O (da Android 17 al debutto dei laptop Googlebook fino alle nuove funzioni AI per Chrome, Android Auto e Wear OS) ha preso la scena “Gemini Intelligence”, una sorta di nuovo marchio ombrello che raccoglie tutte le funzionalità di intelligenza artificiale integrate nel sistema operativo mobile di Mountain View e che rappresenta, in buona sostanza, il passaggio dall’era dello smartphone “reattivo” a quella del telefono “agentico”. Google, infatti, è assolutamente convinta di aver introdotto una delle trasformazioni più profonde mai viste nell’esperienza di Android e descrive Gemini Intelligence come un vero e proprio “layer AI” integrato nel sistema operativo. Quanto alle tempistiche di rilascio, la nuova piattaforma debutterà inizialmente solo su alcuni dispositivi selezionati (in particolare i futuri Pixel 10 e i Samsung Galaxy S26) per poi estendersi entro fine anno a tablet, auto, laptop e dispositivi indossabili, senza che Google abbia specificato date precise per il lancio sul mercato europeo.

Da chatbot a “intelligence layer”

La trasformazione su cui fa leva BigG è soprattutto concettuale: se fino a oggi Gemini era percepito come un assistente di intelligenza artificiale evoluto, alternativo ai chatbot concorrenti, Gemini Intelligence entra invece nel cuore del sistema operativo. Android non viene di conseguenza più presentato come un ambiente che esegue applicazioni, ma come un’infrastruttura intelligente capace di coordinare servizi, dati personali e interazioni in tempo reale. La svolta, se tale la si può definire, è che Gemini non si limita a rispondere a domande ma può svolgere azioni e nasce proprio per rendere Android “molto più proattivo” nella gestione delle attività quotidiane. Google parla in tal senso di “task automation”, e cioè di automazione di azioni multi-step all’interno delle app.

Cosa significa, in termini concreti? Che l’utente può chiedere allo smartphone di organizzare un’attività complessa (per esempio prenotare una corsa in taxi, acquistare prodotti, cercare informazioni in Gmail, confrontare offerte online o altro ancora) lasciando al sistema il compito di eseguire i vari passaggi. Gemini Intelligence, come osservano diversi addetti ai lavori, segna un’evoluzione che avvicina Android al concetto di “AI agent”, un’intelligenza trasversale che orchestra funzioni e servizi superando il concetto di applicazioni separate che richiedono input continui. E Google, giustamente, “celebra” questa evoluzione definendola una transizione “from operating system to intelligence system”.

Lo smartphone comprende ciò che vede

Uno degli aspetti più innovativi di Gemini Intelligence riguarda la capacità di interpretare il contesto visivo. L’AI, in altre parole, può analizzare ciò che compare sullo schermo dello smartphone, leggere screenshot, immagini e contenuti aperti nelle app per trasformarli in azioni operative. In sede di presentazione, i responsabili di Google hanno mostrato in demo alcune funzionalità emblematiche di questa capacità: dal fotografare un depliant turistico per cercare esperienze di viaggio analoghe sulle piattaforme di booking all’utilizzare una lista della spesa ricevuta via e-mail per creare automaticamente un ordine di acquisto online fino a recuperare informazioni da Gmail o Google Photos per completare moduli e prenotazioni. L’obiettivo di fondo è eliminare la frammentazione tipica dell’esperienza mobile, dove l’utente è costretto a copiare dati tra applicazioni diverse.

Per superare questo limite, la tecnologia di Gemini Intelligence sfrutta algoritmi OCR e sistemi di computer vision per “capire” ciò che appare sul display e grazie all’integrazione con Gmail, Photos e Wallet la nuova funzione Autofill permette ad Android di compilare campi complessi utilizzando dati personali contestuali, sempre con il consenso dell’utente. Google, insomma, sembra aver dato un’accelerata all’idea di differenziare il suo sistema operativo Android “aumentandolo” con le capacità dell’AI e lo fa rimarcando il tema del rispetto della privacy. Gemini Intelligence, come hanno ribadito con enfasi i manager di BigG, agisce soltanto dopo una richiesta esplicita dell’utente e lascia sempre allo stesso utente la conferma finale per azioni sensibili come acquisti o prenotazioni: sarà sufficiente assicurare che le funzioni sono siano “opt-in”, e quindi controllabili e disattivabili, per non cadere nella trappola delle violazioni dei dati personali? Questo è il tema che solleva probabilmente l’entrata in scena di Gemini Intelligence.